Weekly newsletter #31

今週はGoogle I/O(開発者向け年次イベント)が開催され、興味深いニュースが沢山ありましたので、その中からいくつかピックアップしてご紹介したいと思います。少しだけ関連するトピックも。

まずは、イベントで発表された内容の短いサマリー映像のリンクを貼っておきますので、ご覧になってない方はこちらをどうぞ。

Googleは対話型の次世代AI「LaMDA」をデモ

Google Home やAlexa が出てきた時、SF映画に出てくるようにAIと自然に会話する姿を想像していましたが、実際は違いました。自分の言っていることをなかなか認識してもらえず、「分かりません」と返答される経験を皆さんもお持ちでしょう。

新しい言語モデル「LaMDA」は会話の文脈を理解し、どんなトピックでも会話できるように設計されています。LaMDAは、ニューラルネットワークアーキテクチャTransformer をベースに構築され、複数の単語が互いにどのように関係しているかに注目して次に来る単語を予測、訓練できるモデルで、これを対話型で学習したモデルです。

関連する技術として、MUM(Multitask Unified Model:マルチタスク統合モデル)という新しい検索技術が紹介された。これは、マルチタスクを実行できるマルチモーダルモデルで、同時に75の異なる言語でトレーニングされ、テキスト、画像、ビデオ、オーディオなど、様々な形式の情報(マルチモーダル)を理解できます。

「富士山にハイキングしたいが、何を準備すればいいですか?」という検索例が紹介されていました。従来は英語で検索した場合、日本語で書かれた富士山の情報を見つけることはできませんでしたが、MUMでは言語を超えて関連性の高い結果を見つけることが可能になります。また、ハイキングブーツの写真を示して「これを使って富士山をハイキングできますか?」と尋ねれば、画像の内容と検索の意図を理解し、ハイキングブーツが適切であると回答するという。

これらが実用化されれば、思い描いていたSF映画の世界へまた一歩近づきますね。

https://venturebeat.com/2021/05/18/google-demos-lamda-a-next-generation-ai-for-dialogue/

Googleは等身大の3Dビデオ会議を作っています

Googleは、3Dディスプレイと3D画像を利用して、すぐ目の前に相手がいるような映像を映し出すビデオ会議システム「Project Starline」の開発に取り組んでいます。

高解像度カメラと深度センサーによって、複数の角度から人物をキャプチャし、ライブ3Dモデルを作成し、相手の視点に合わせるように画像を調整します。3D映像といえば、これまで特殊なメガネやヘッドセットを必要としていましたが、それらを必要とせず、リアルな3D体験を可能としています。

但し、特注のハードウェアや専用ブースの構築が必要で、かなり高価なものになるだろうと予測されています。かつて、Ciscoを初めとして各社が高価なテレプレゼンスシステムを開発し、企業の立派な役員会議室などに導入していたのを彷彿とさせます。

https://techcrunch.com/2021/05/18/google-is-making-a-3d-life-size-video-calling-booth/

Microsoftは会議に対する将来のビジョンを示しました

Microsoftもまたビデオ会議において、Googleと似たようなアプローチをしています。パンデミック後も在宅と出社のハイブリッド型のワークスタイルを推奨している同社にとっては自然な流れかも知れませんが、リモートに居ながらも同じ会議室で対面している感覚を演出する仕組みです。より大きなスクリーンで、目の高さにカメラを設置してアイコンタクトを取りやすくし、相手の声を聞き取りやすくする空間音響を構築します。

https://www.theverge.com/2021/5/21/22447048/microsoft-teams-future-meetings-features

Otter.ai はZoom会議を自動的に書き起こします

もう一つビデオ会議のネタです。Otter.aiは、米国駐在員の間でもよく使われているアプリで、カンファレンスなどの講演の音声を録音して文字起こししてくれ、一定時間までは無料で利用できます。新機能の「Otter Assistant」は、カレンダー上のZoomミーティングに自動的に参加して会話を書き起こし、そのメモを他の参加者と共有できます。さらに、これは会議の開始時に有効にしたり、終了時に停止したりする必要もなく、自動的に動作してくれるそうです。

Googleは2029年までに実用的な量子コンピューターを構築

Googleは、カリフォルニア州サンタバーバラに新しい量子AIキャンパスを開設すると発表。量子データセンター、ハードウェア研究所、量子プロセッサチップ製造施設などが含まれます。ここでは、2029年までに100万量子ビット(qubits)を搭載して誤り補正ができる量子コンピューターを開発するという。量子ビットとは、基本的なデータ処理要素だが、外部からの影響を受けやすく計算を狂わせるため、量子コンピューターには誤り補正技術が重要になってくる。そして、世界初の「量子トランジスタ」を作って、それを数百から数千個並べて量子演算させることになるため、実現するにはまだ時間がかかるようです。

https://www.cnet.com/news/google-plans-to-build-a-practical-quantum-computer-by-2029-at-new-center/

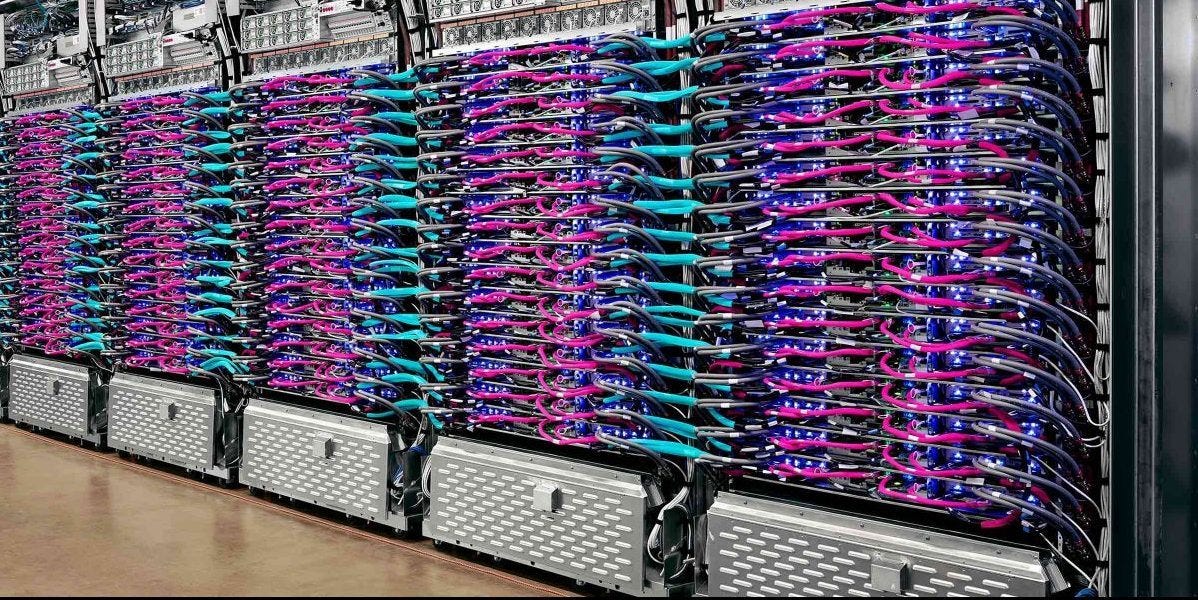

GoogleがTPU v4 AIチップを発表

Googleは、最新のTPU v4(Tensor processing unit)を発表しました。TPUv4のクラスターは、オブジェクト検出、画像分類、自然言語処理、機械翻訳などのワークロードで、第3世代TPU(TPUv3)の2倍以上の性能を提供します。TPUとは、AIを高速化するために開発された特定用途向け集積回路(ASIC)で、1秒間に何回の浮動小数点演算を可能にするかを示す指標のFLOPSが、最大100ペタ(千兆)FLOPSに及ぶコンピューティングです。また、4,096台のTPU v4を組み合わせた「ポッド」と呼ばれるユニットを構成し、それを相互接続させることでメモリ帯域幅を大幅に向上させます。その1ポッドは、1エクサ(百京)FLOPSもの演算性能を実現します。

https://venturebeat.com/2021/05/18/google-details-new-ai-accelerator-chips/